Anthropic lance un outil IA de code review pour traquer les bugs dans vos pull requests

Qui review les reviewers ? — Anthropic vient de dévoiler Code Review, un nouvel outil intégré à Claude Code qui déploie plusieurs agents IA en parallèle pour analyser vos pull requests sur GitHub.

L'idée est simple : à mesure que les outils de codage assisté par IA font exploser le volume de code produit (et donc de PR à relire), il fallait bien que quelqu'un (ou quelque chose) vienne prêter main-forte aux équipes de développement dont certaines commencent à réellement crouler sous les reviews.

Des agents IA qui bossent en parallèle

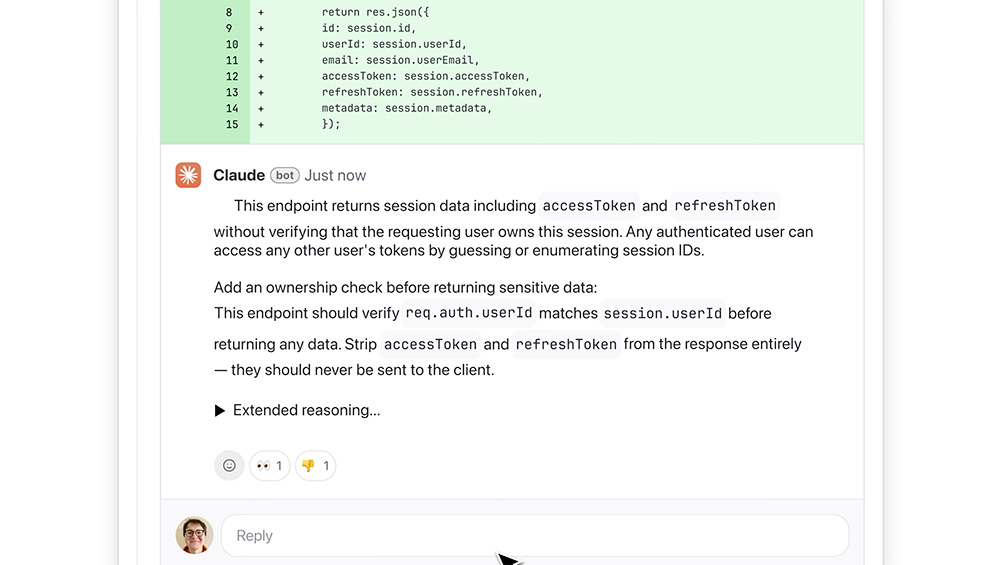

Concrètement, Code Review fonctionne comme un reviewer automatique qui se déclenche sur vos pull requests GitHub : plusieurs agents Claude examinent le code simultanément, croisent leurs trouvailles, puis publient des commentaires directement sur la PR.

Le parti pris d'Anthropic est intéressant : l'outil se concentre exclusivement sur les erreurs logiques, pas sur le style. Exit les remarques sur vos espaces vs tabs ou vos conventions de nommage (on se sait 👀), Code Review veut cibler les vrais problèmes : régressions d'autorisation, handlers de webhooks non idempotents, transactions financières sans boundaries, dépendances inter-fichiers cassées et j'en passe...

En se concentrant uniquement sur les erreurs de logique, Anthropic veut prendre en charge les problèmes les plus critiques à corriger.

Un système de sévérité intégré

Chaque commentaire posté par Code Review se voit accompagné d'un niveau de sévérité :

- Rouge : priorité maximale, à corriger impérativement

- Jaune : problème potentiel, à examiner

- Violet : problème préexistant détecté au passage

Selon les premiers retours, 54% des PR reçoivent désormais des commentaires substantiels, contre 16% avec les approches précédentes. Et moins de 1% des remontées sont jugées incorrectes par les ingénieurs, un taux de faux positifs remarquablement bas pour ce type d'outil.

On notera néanmoins que chaque review prend environ 20 minutes et coûte entre 15 et 25 dollars (!) selon la complexité du code. On est clairement sur du tooling pensé pour les équipes, pas une solution pensée pour le dev solo qui push ses side projects le dimanche soir.

REVIEW.md, le nouveau fichier à maintenir

Pour personnaliser le comportement de l'outil, Anthropic propose deux fichiers de configuration :

Un REVIEW.md qui permet de définir les instructions de review et les critères de priorisation

Un CLAUDE.md pour fournir le contexte du repo, l'architecture et les conventions du projet

Si vous utilisez déjà Claude Code, vous connaissez sans aucun doute le principe du CLAUDE.md. L'idée reste la même : donner au modèle suffisamment de contexte pour qu'il comprenne votre codebase et surtout ses éventuelles particularités.

Disponibilité et limites

Code Review est disponible en "research preview" pour les abonnés Claude for Teams et Claude for Enterprise. Les organisations qui ont activé le Zero Data Retention ne peuvent pas l'utiliser — ben oui logique, puisque l'outil a besoin de lire votre code pour le review. 👀

L'installation passe par l'ajout de l'app GitHub d'Anthropic à vos repos, et les team leads peuvent l'activer par défaut pour l'ensemble de leur équipe.

Anthropic a également lancé en parallèle Claude Code Security, un outil d'analyse de sécurité plus approfondi qui vient compléter toute cette stack de review.

En pleine hype, le timing n'est pas anodin : les abonnements entreprise d'Anthropic ont quadruplé depuis le début de l'année, et le revenu annualisé de Claude Code a dépassé les 2,5 milliards de dollars.

À propos de l'auteur

Nicolas Lecointre

Chief Happiness Officer des développeurs, ceinture noire de sudo. Pour rire, j'ai créé Les Joies du Code. J'utilise Vim depuis 10 ans parce que je sais pas comment le quitter.

Articles similaires

Claude ouvre son contexte à 1 million de tokens : ce que ça change vraiment

OpenAI ferme Sora, son app de vidéo IA, six mois après son lancement

Anthropic laisse fuiter 512 000 lignes de Claude Code sur npm

OpenAI lance ChatGPT Pro à 100$/mois pour les devs qui abusent de Codex

Claude ouvre son contexte à 1 million de tokens : ce que ça change vraiment

OpenAI ferme Sora, son app de vidéo IA, six mois après son lancement

Anthropic laisse fuiter 512 000 lignes de Claude Code sur npm

OpenAI lance ChatGPT Pro à 100$/mois pour les devs qui abusent de Codex

Plus de contenu

Quand je pense avoir terminé mon dev et que le testeur me remonte un bug critique

Quand j'apprends que je vais devoir travailler sur une fonctionnalité majeure demandée par le PDG

Quand je livre un truc à l'arrache et que ça marche

Quand le client en est au moins à sa 10ème demande d'évolution pour la même fonctionnalité

Quand mon code impeccable la semaine dernière ne fonctionne plus sans aucune raison apparente

Y'a des jours sans

Quand notre cluster Kubernetes tombe

Quand mon code n'est pas bon mais que ça marche quand même

Quand je pense avoir terminé mon dev et que le testeur me remonte un bug critique

Quand j'apprends que je vais devoir travailler sur une fonctionnalité majeure demandée par le PDG

Quand je livre un truc à l'arrache et que ça marche

Quand le client en est au moins à sa 10ème demande d'évolution pour la même fonctionnalité

Quand mon code impeccable la semaine dernière ne fonctionne plus sans aucune raison apparente