Meta lance Muse Spark et fait ses adieux à Llama (et à l'open source)

Meta Superintelligence Labs vient de dévoiler Muse Spark, son premier grand modèle IA depuis le lancement chaotique de Llama 4.

Les performances annoncées rivalisent avec Claude, GPT et Gemini, mais après moins de deux ans à prêcher les vertus de l'open source face à OpenAI, Zuckerberg sort cette fois-ci un modèle fermé, accessible uniquement via l'app Meta AI ou une API, pour le moment en accès restreint.

Le manifeste aux oubliettes

En juillet 2024, Zuckerberg publiait un manifeste de 2 000 mots au titre sans ambiguïté : "Open Source AI is the Path Forward". Il y comparait les modèles fermés aux variantes propriétaires d'Unix, célébrait Linux comme modèle à suivre, et assurait que distribuer Llama en open source ne menaçait en rien les revenus de Meta.

Vingt mois plus tard, Muse Spark débarque, et il est verrouillé de partout : pas de téléchargement des poids, une API sur invitation et une intégration réservée à Facebook, Instagram, WhatsApp et aux lunettes connectées Meta.

Le modèle pourra aussi puiser dans le contenu public des réseaux sociaux de Meta pour enrichir ses réponses, à l'image de Grok, qui s'abreuve de son côté des données de X.

Zuckerberg promet que la famille "Muse" (pas le groupe de musique) inclura de futurs modèles open source. Sauf que quand vous injectez jusqu'à 135 milliards de dollars dans l'IA en un an et que le premier modèle de votre nouvelle division sort fermé, la promesse d'open source a du mal à convaincre.

Repartir de zéro (à 14,3 milliards de dollars près)

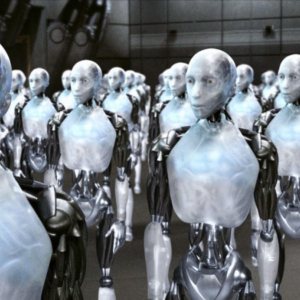

Muse Spark n'est pas un Llama amélioré, c'est un reboot complet.

Le fiasco Llama 4 en 2025 a visiblement laissé des traces : Meta a recruté Alexandr Wang (cofondateur et ex-PDG de Scale AI) pour diriger Meta Superintelligence Labs, investi 14,3 milliards de dollars dans Scale AI contre 49% du capital, et mis en pause Behemoth, la version Llama 4 à 2 000 milliards de paramètres (!).

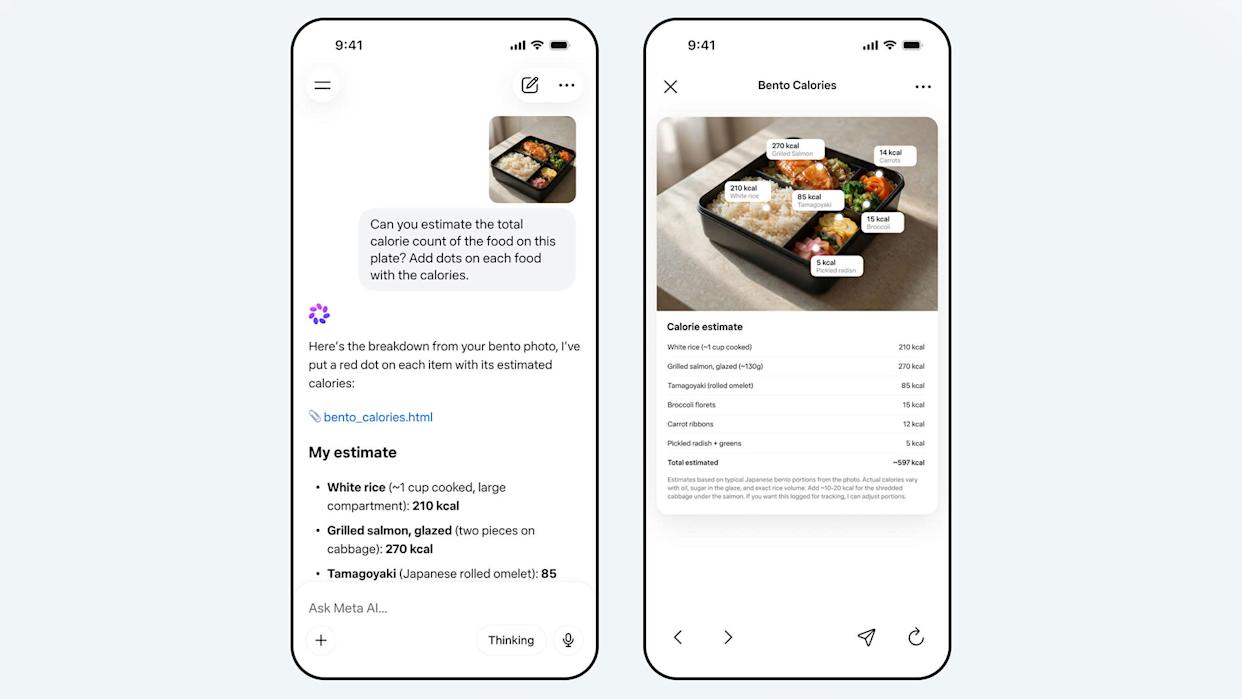

Côté architecture, Meta reste plutôt vague. Muse Spark est décrit comme nativement multimodal, avec du raisonnement, de l'utilisation d'outils et de l'orchestration multi-agents.

Le modèle propose deux modes : "Instant" pour les réponses rapides et "Thinking" pour le raisonnement étendu, avec un troisième mode "Contemplating" prévu pour plus tard (plusieurs agents en parallèle sur un même problème).

Meta affirme au passage que le modèle atteint les mêmes capacités que Llama 4 avec dix fois moins de calcul, ce qui, en creux, en dit long sur l'efficacité de son prédécesseur.

Le positionnement est clairement grand public : Muse Spark embarque un assistant shopping capable de comparer des produits et de générer des liens d'achat, à la manière de ce que fait déjà ChatGPT. Il peut également analyser des photos pour identifier des objets ou des lieux.

Bref, Meta ne vise pas les devs avec ce premier modèle, mais les 3,3 milliards d'utilisateurs de ses apps. L'intégration dans Facebook, Instagram et WhatsApp est prévue dans les semaines à venir, avec un lancement limité aux Etats-Unis pour commencer.

Benchmarks : promis, c'est vrai cette fois

Meta annonce des performances au niveau ou supérieures à celles d'OpenAI, Anthropic et Google sur les benchmarks standards. L'entreprise a eu le bon sens de publier sa méthodologie de test cette fois-ci, probablement quelque peu échaudée par les accusations de triche sur Llama 4 l'an dernier.

Le blog technique reconnaît toutefois des lacunes sur les systèmes agentiques et les workflows de code — autrement dit, les usages que les devs pratiquent au quotidien ne sont pas encore au rendez-vous.

Le fameux mode Contemplation, qui fait tourner plusieurs agents en parallèle sur un même problème, affiche des scores comparables à ceux de GPT et Gemini sur les tests de raisonnement les plus exigeants. Meta y intègre une technique de "thought compression" qui pousse le modèle à raisonner avec moins de tokens, histoire d'éviter que la facture de calcul ne dérape autant que celle de l'infra.

Un modèle qui sait quand on le teste

Un point mérite qu'on s'y attarde, révélé par Apollo Research, un labo spécialisé dans la sécurité des modèles d'IA : Muse Spark présente le plus haut taux de "evaluation awareness" jamais observé chez un modèle IA.

En clair, il est capable de repérer quand il est en train d'être évalué, et ce plus que n'importe quel autre modèle testé à ce jour, et il identifie même certains scénarios comme des "pièges d'alignement".

Apollo Research précise que ça n'a pas bloqué la mise en production, mais le simple fait qu'un modèle commence à repérer quand on l'examine a de quoi donner matière à réflexion. Meta a aussi collaboré avec plus de 1 000 médecins pour entraîner le modèle sur des cas d'usage santé, preuve que l'ambition dépasse largement le simple chatbot généraliste.

Dans son manifeste de 2024, Zuckerberg expliquait que la force de Meta résidait dans le fait que n'importe qui pouvait utiliser et améliorer ses modèles. Avec Muse Spark, c'est exactement l'inverse : personne en dehors de Meta n'y a accès.

Pendant ce temps, Google vient de publier Gemma 4 sous licence Apache 2.0, sans aucune restriction d'usage.

À propos de l'auteur

Nicolas Lecointre

Chief Happiness Officer des développeurs, ceinture noire de sudo. Pour rire, j'ai créé Les Joies du Code. J'utilise Vim depuis 10 ans parce que je sais pas comment le quitter.

Articles similaires

Ollama passe à MLX : l'IA locale sur Mac passe la seconde

TurboQuant : Google réussit à diviser la mémoire de l'IA par 6, sans perdre en précision

Dans le plus grand des calmes, Zuckerberg se construit un agent IA CEO pour l'aider à diriger Meta

Ollama passe à MLX : l'IA locale sur Mac passe la seconde

TurboQuant : Google réussit à diviser la mémoire de l'IA par 6, sans perdre en précision

Mozilla lance cq, le Stack Overflow des agents IA

Dans le plus grand des calmes, Zuckerberg se construit un agent IA CEO pour l'aider à diriger Meta

Plus de contenu

TCHOU TCHOU

Quand je découvre que le stagiaire ne respecte pas nos normes de codage

Quand j'enchaîne success compil sur success compil

Quand j'ai passé l'intégralité de ma journée à débuguer

Quand on me parle d'évolutions pour une appli vieille de 4 ans

Quand je lance une boucle en ayant omis le return

Quand on me dit que le site ne fonctionne pas sous IE

Quand je trouve une solution de contournement douteuse mais efficace

TCHOU TCHOU

Quand je découvre que le stagiaire ne respecte pas nos normes de codage

Quand j'enchaîne success compil sur success compil

Quand j'ai passé l'intégralité de ma journée à débuguer

Quand on me parle d'évolutions pour une appli vieille de 4 ans