OpenAI présente Whisper, son IA de reconnaissance vocale multilingue open source

OpenAI présente sa dernière IA en date : Whisper. Derrière ce nom, un système de reconnaissance vocale multilingue à la précision redoutable, qui plus est open source.

La reconnaissance vocale a toujours été un domaine particulièrement complexe à traiter pour les IA (coucou les sous-titres auto-générés sur YouTube 👋).

Alors que des géants de la tech comme Google, Amazon, Apple et Meta disposent chacun de leur propre système de reconnaissance vocale, bien souvent intégré au coeur de leurs services, OpenAI propose avec Whisper de mettre à disposition de la communauté open source une IA robuste, adaptée à plusieurs langues et capable de les traduire en anglais.

Selon le laboratoire de recherche, que l'on connaît déjà pour ses produits GPT-3 (IA capable d'écrire), DALL-E (générateur d'images à partir de texte), mais aussi OpenAI Codex (utilisé par GitHub Copilot), Whisper se classerait au-dessus des systèmes de retranscription vocale déjà existant par le volume de ses données d'entraînement.

Rendez-vous compte : 680 000 heures de données multilingues et "multitâches" collectées sur le web ont été exploitées pour l'apprentissage de Whisper. Ce jeu de données colossal permettrait ainsi à cette IA, selon les ingénieurs d'OpenAI, d'être capable de reconnaître et comprendre des accents, dont certains peu communs, mais également de faire un focus sur la parole malgré la présence de bruit de fond, et de comprendre du jargon technique.

Dans le billet publié sur son blog officiel, le laboratoire présente 4 exemples d'audios traités par OpenAI. Parmi ces 4 fichiers audio, un anglais à la vitesse de la lumière ("speed talking"), un extrait d'une chanson de K-Pop (meh), un audio avec un accent écossais à couper au couteau (à la hache, même) et... du français (cocorico) !

Sous chacun de ces audios, OpenAI affiche la retranscription formulée par l'IA, et à l'exception d'une petite coquille (assumée) pour la retranscription de l'audio en accent écossais, c'est un sans-faute pour la nouvelle IA du labo.

Whisper a néanmoins ses limitations, sur la partie prédiction de texte entre autres : le système ayant été entraîné sur des données volontairement "bruyantes", OpenAI avertit qu'il n'est pas impossible que l'IA puisse parfois ajouter d'elle-même certains mots n'ayant pas été prononcés dans ses retranscriptions.

De même, et ça se comprend, Whisper n'excelle pas pour tous les langages, notamment pour ceux qui n'étaient pas forcément représentés dans son jeu de données (seulement un tiers du jeu de données audio n'était pas en anglais).

OpenAI espère que la précision élevée de Whisper et sa facilité d'intégration permettra aux développeurs de mettre en place des interfaces vocales dans de plus nombreuses applications, ce qui pourrait contribuer de manière générale à améliorer l'accessibilité numérique.

L'équipe d'OpenAI a partagé son document de recherche à propos de Whisper ainsi que le projet dans un GitHub dédié.

À lire aussi sur Les Joies du Code :

- 🧠 L'IA GPT-3 serait capable de rédiger des mémoires de fin d'études en moins de 20 minutes

- 🗣 Ce site web est capable de traduire du texte en regex

- 🔎 Il cracke la sécurité de sa voiture Hyundai avec une simple recherche Google

À propos de l'auteur

Nicolas Lecointre

Chief Happiness Officer des développeurs, ceinture noire de sudo. Pour rire, j'ai créé Les Joies du Code. J'utilise Vim depuis 10 ans parce que je sais pas comment le quitter.

Articles similaires

DevDay : toutes les annonces de la première conférence pour développeurs d'OpenAI

Des chercheurs créent 3D-GPT, une IA qui génère des mondes virtuels avec des prompts à la ChatGPT

Après de trop nombreux incidents, la Californie siffle la fin des voitures autonomes sur ses routes

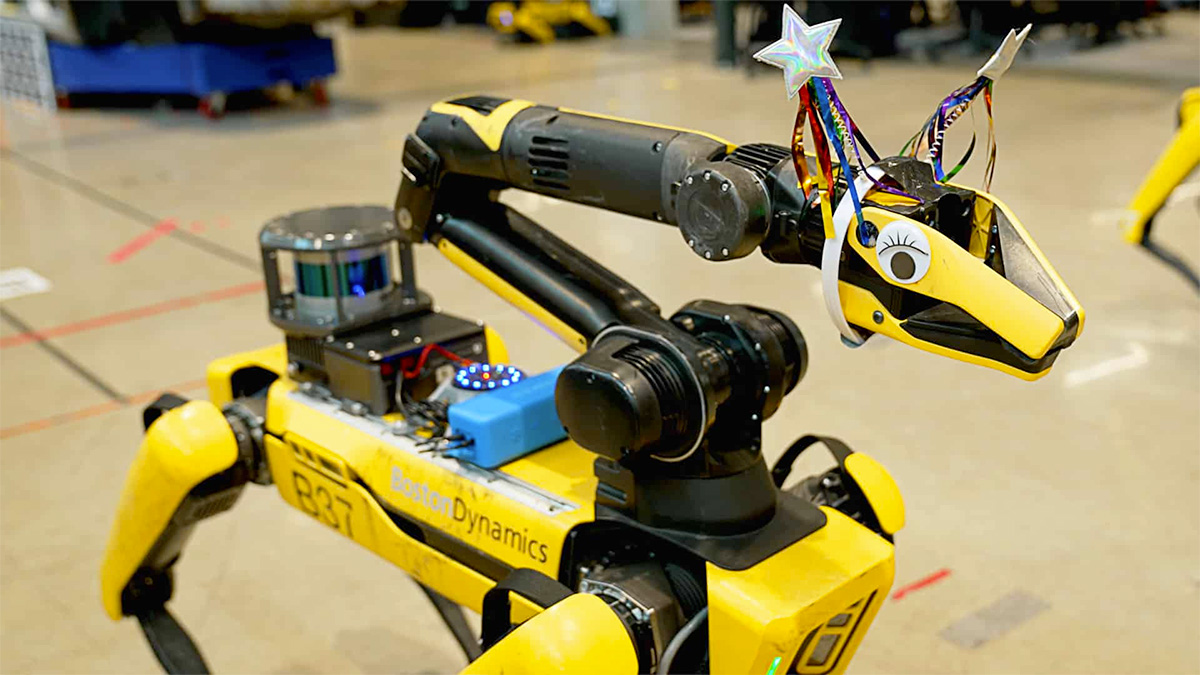

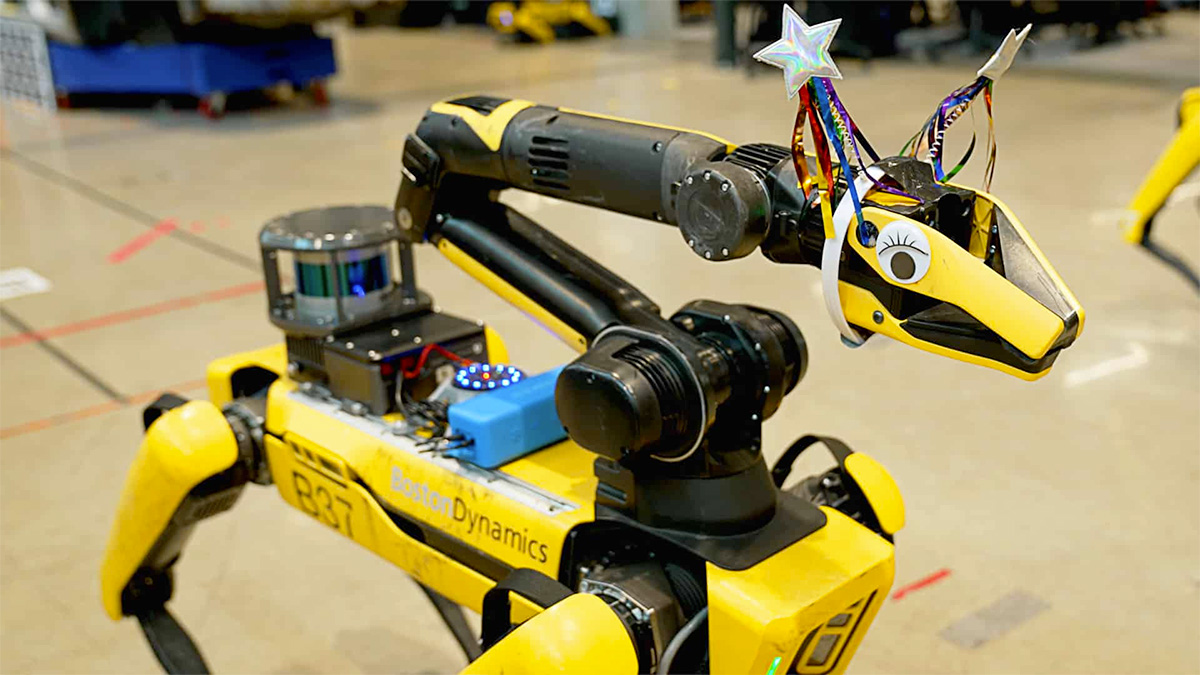

Le robot-chien de Boston Dynamics sait maintenant parler grâce à ChatGPT

DevDay : toutes les annonces de la première conférence pour développeurs d'OpenAI

Des chercheurs créent 3D-GPT, une IA qui génère des mondes virtuels avec des prompts à la ChatGPT

Après de trop nombreux incidents, la Californie siffle la fin des voitures autonomes sur ses routes

Le robot-chien de Boston Dynamics sait maintenant parler grâce à ChatGPT

Plus de contenu

Quand je réalise que je viens de supprimer des données sensibles en production

Allez hop

Quand on me demande si j'ai bien testé mon code

Quand je compile mon projet pour la 20ème fois

Magnifique.

Quand je demande au client de m'envoyer par mail sa liste de demandes d'évolution

Quand je vois la pile de tickets qui m'attend le lundi matin

Quand j'ouvre le gestionnaire de tickets un lendemain de mise en prod

Quand je réalise que je viens de supprimer des données sensibles en production

Allez hop

Quand on me demande si j'ai bien testé mon code

Quand je compile mon projet pour la 20ème fois

Magnifique.