OpenAI ouvre l'accès à o1-pro, son modèle d'IA le plus puissant et coûteux pour les développeurs

OpenAI vient de rendre disponible son nouveau modèle d'IA o1-pro, via son API réservée aux développeurs.

Celui-ci serait le modèle de raisonnement le plus puissant créé à ce jour par l'entreprise, utilisant davantage de puissance de calcul que le modèle o1 "classique" pour fournir des réponses systématiquement meilleures.

Seul hic : ça coûte une blinde (mais genre vraiment).

OpenAI facture en effet pour ce modèle 150 dollars le million de tokens (environ 750 000 mots) envoyés au modèle pour l'alimenter, et 600 dollars par million de tokens générés. C'est le double du prix d'usage du modèle GPT-4.5 et 10 fois (!) les prix appliqués pour son modèle o1.

Autant dire qu'à ce tarif, les perfs ont intérêt d'être au rendez-vous. Mais l'entreprise de Sam Altman se montre confiante : selon elle, les développeurs constateront une amélioration suffisamment nette des résultats pour justifier ces coûts pharaoniques.

On notera cependant que les premiers retours des utilisateurs du service ChatGPT Pro, pour lesquels o1-pro est disponible depuis décembre, sont plutôt mitigés. Certains ont par exemple remonté que le modèle rencontrait des difficultés sur des tâches simples comme la résolution de Sudokus.

Les benchmarks internes menés par OpenAI indiquent quant à eux que le modèle o1-pro se montre seulement légèrement supérieur au modèle standard sur des tâches de programmation et la résolution de problèmes mathématiques, les réponses fournies étant néanmoins plus fiables.

L'utilisation du modèle o1-pro est réservé aux développeurs dépensant au moins 5 dollars pour ses services d'API. Avec ce lancement, OpenAI entend répondre à une forte demande de sa communauté de développeurs, même si l'efficacité réelle du modèle reste à prouver sur le long terme face à un coût si conséquent.

Modèle o1-pro sur la plateforme développeurs d'OpenAI

À lire aussi sur Les Joies du Code :

- 🧠 Junie, l’agent IA de JetBrains qui veut (presque) coder à votre place

- 🏎️ TypeScript bientôt 10 fois plus rapide grâce à Go

- 📊 Étude : les nouvelles tendances de l’écosystème des développeurs en 2025

À propos de l'auteur

Nicolas Lecointre

Chief Happiness Officer des développeurs, ceinture noire de sudo. Pour rire, j'ai créé Les Joies du Code. J'utilise Vim depuis 10 ans parce que je sais pas comment le quitter.

Articles similaires

Ce site fait s’affronter des IA pour créer des modèles Minecraft

Meta soupçonné d'avoir triché pour faire briller son nouveau modèle Llama 4 dans les benchmarks d'IA

OpenAI dévoile GPT-4.1 : son modèle IA nouvelle génération pensé pour les développeurs

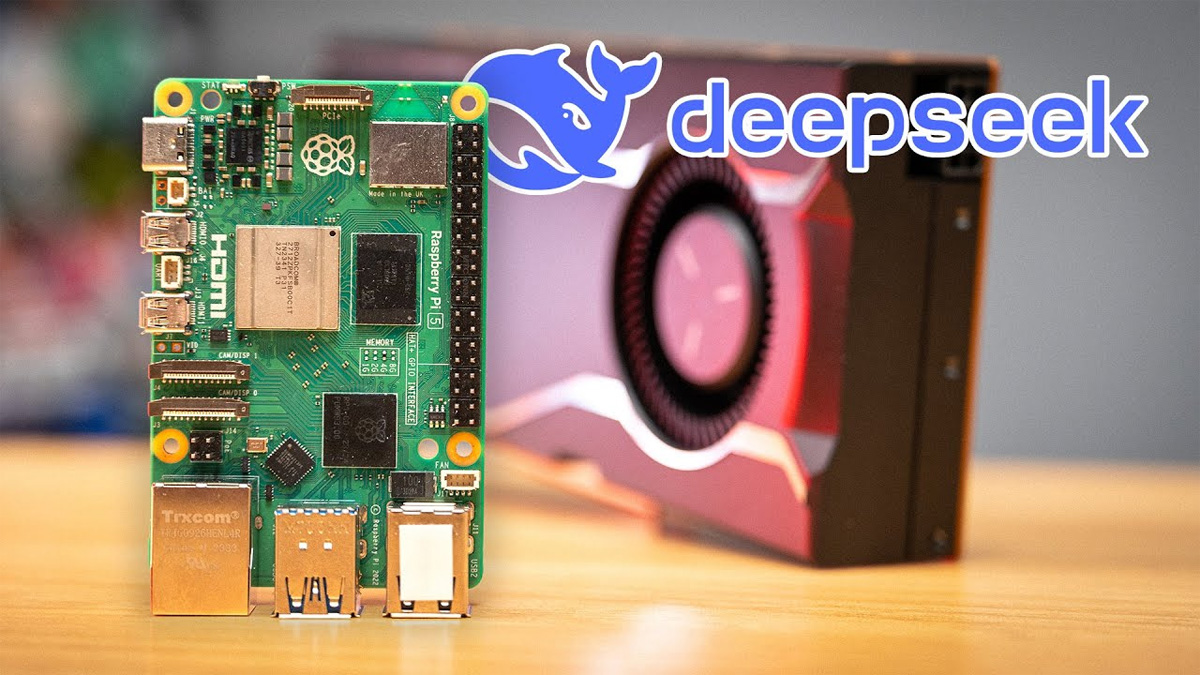

À peine sorti, un développeur fait tourner le modèle DeepSeek R1 sur un Raspberry Pi

Ce site fait s’affronter des IA pour créer des modèles Minecraft

Meta soupçonné d'avoir triché pour faire briller son nouveau modèle Llama 4 dans les benchmarks d'IA

OpenAI dévoile GPT-4.1 : son modèle IA nouvelle génération pensé pour les développeurs

À peine sorti, un développeur fait tourner le modèle DeepSeek R1 sur un Raspberry Pi

Plus de contenu

Quand j'ouvre un ticket prioritaire à 16h58 un vendredi et que je sens tous les regards se tourner vers moi

Quand je vois un fix-final-v3-definitive dans les noms de branche

Quand je reçois un message "URGENT PROD DOWN" pendant mes vacances

Quand j'ai pris le temps de bien préparer mon update et que j'oublie le where à l'exécution

Bon ben on est cuits

Quand ça fait 2 ans que je travaille sur le même projet

Quand je reçois toutes les nouvelles demandes du commercial

Quand on me demande comment j’ai corrigé un bug alors que c’est ChatGPT qui l’a fait

Quand j'ouvre un ticket prioritaire à 16h58 un vendredi et que je sens tous les regards se tourner vers moi

Quand je vois un fix-final-v3-definitive dans les noms de branche

Quand je reçois un message "URGENT PROD DOWN" pendant mes vacances

Quand j'ai pris le temps de bien préparer mon update et que j'oublie le where à l'exécution

Bon ben on est cuits