Mozilla lance cq, le Stack Overflow des agents IA

Mozilla.ai vient de dévoiler cq, un projet open source décrit comme le Stack Overflow pour les agents IA. Le pitch : une base de connaissances collective où les agents IA...

Mozilla.ai vient de dévoiler cq, un projet open source décrit comme le Stack Overflow pour les agents IA. Le pitch : une base de connaissances collective où les agents IA...

Apple a officiellement annoncé ce lundi que la WWDC 2026, sa grand-messe annuelle dédiée aux développeurs, se tiendra du 8 au 12 juin. En ligne, gratuite, et avec un événement...

Microsoft a officiellement publié en ce début de semaine TypeScript 6.0, et cette release a une saveur toute particulière : il s'agit en effet de la dernière version du compilateur...

Six mois et puis s'en va — OpenAI vient d'annoncer ce mardi 24 mars la fermeture de son application de génération de vidéos par IA Sora, qui se voulait le...

Quand un outil de cyberespionnage se retrouve en libre-service sur GitHub, c'est rarement bon signe. La semaine dernière, des chercheurs en cybersécurité découvraient DarkSword, un kit d'exploitation avancé utilisé par...

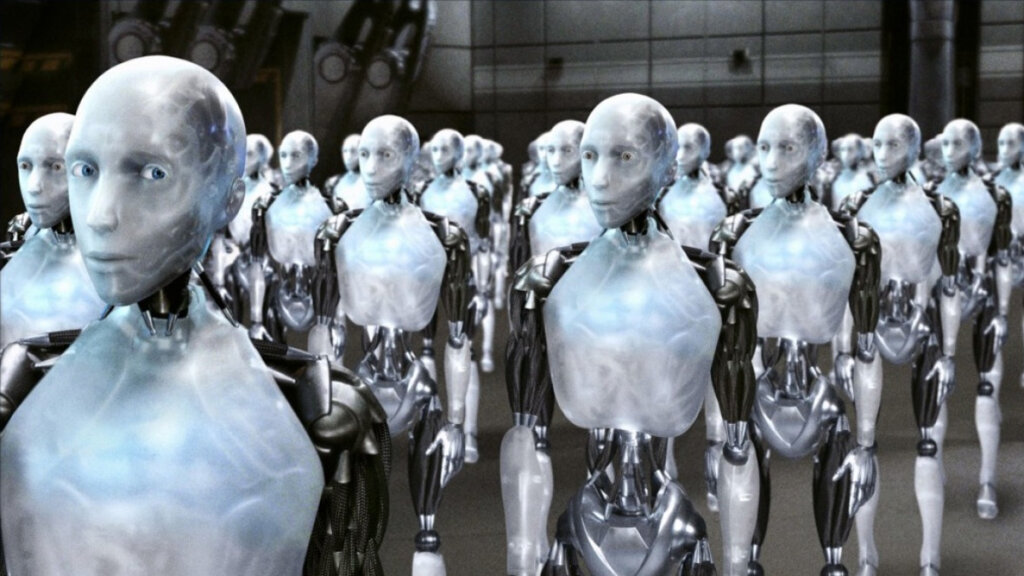

Mark Zuckerberg veut que chaque employé de Meta ait son propre agent IA "ultime". Logique, quand on dirige une boîte qui prévoit de claquer entre 115 et 135 milliards de...

Un acteur malveillant affirme sur BreachForums détenir un accès à un "parent account" d'OVHcloud et met en vente ce qu'il décrit comme 590 téraoctets de données extraites des serveurs du...

Des étoiles plein les yeux — Si vous utilisez Ubuntu depuis un moment, vous connaissez évidemment ce fonctionnement : vous tapez sudo, le terminal vous demande votre mot de passe,...

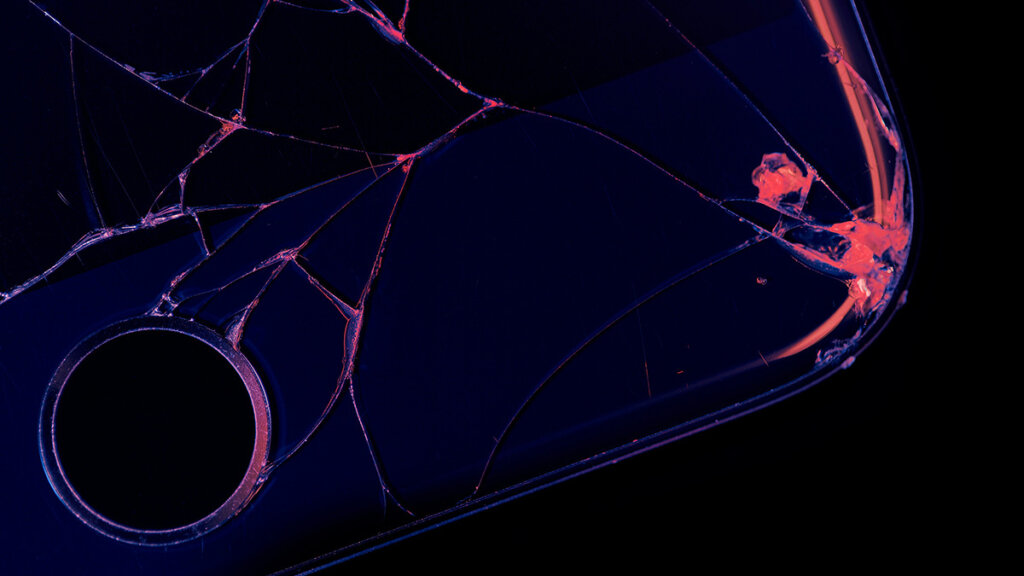

Depuis fin février, le détroit d'Hormuz est au cœur d'une crise majeure. Après les frappes américano-israéliennes sur l'Iran, Téhéran a riposté en minant le passage maritime le plus stratégique de...

Ni React, ni Electron — Former Lab vient de publier fortransky sur GitHub : un client terminal pour le réseau social Bluesky, intégralement écrit en Fortran. Pour ceux qui auraient...