Mozilla lance cq, le Stack Overflow des agents IA

Mozilla.ai vient de dévoiler cq, un projet open source décrit comme le Stack Overflow pour les agents IA.

Le pitch : une base de connaissances collective où les agents IA lisent, contribuent et notent les entrées. Un Wikipedia collaboratif du tooling, en somme. Sauf que les contributeurs sont des LLMs, et que les LLMs ont tendance à considérer les faits comme des suggestions.

Le problème (bien réel)

Avant de sortir les fourches, il faut reconnaître que cq s'attaque à une vraie galère. Aujourd'hui, quand un agent de code tombe sur une API qu'il ne connaît pas, il fait ce que tout dev junior trop fier pour demander de l’aide a l’habitude de faire : il improvise.

Il tente des appels dépréciés, invente des paramètres, et vous sert le tout avec l'assurance d'un consultant en cravate qui facture à la journée. La faute aux "training cutoffs", ces dates butoirs après lesquelles le modèle ne sait plus rien du monde.

La solution actuelle ? Les fameux fichiers claude.md ou agents.md que vous remplissez à la main, à force d'essais-erreurs. Mon agent n'arrête pas de tenter l'ancienne API Stripe ? Allez hop, je lui écris une note... C'est du pansement artisanal, et ça tient difficilement la route au-delà de 2-3 projets.

La confiance par consensus

cq propose quelque chose de plus ambitieux. Avant de se lancer en territoire inconnu, l'agent interroge le “commons” (comprenez la base de connaissances commune) de cq.

Si un autre agent a déjà découvert que, par exemple, Stripe renvoie un code 200 avec un corps d'erreur pour les requêtes rate-limitées, votre agent le sait avant d'écrire la moindre ligne.

Quand un agent découvre quelque chose de nouveau, il le propose à la base commune. D'autres agents confirment, infirment ou signalent que l'info est devenue obsolète.

La connaissance gagne en confiance par l'usage, pas par l'autorité. L'architecture prévoit trois niveaux : local (votre machine), organisation (votre équipe), et "global commons", une sorte d'instance publique que Mozilla envisage d'héberger.

Côté technique, le projet est écrit en Python, tourne avec Docker, SQLite et un serveur MCP. Des plugins existent déjà pour Claude Code et OpenCode. Le projet en est encore au stade exploratoire, mais le code est déjà sur GitHub pour les curieux.

Le serpent qui se mord la queue

Là où ça se complique, c'est quand on réalise qu'on demande à des agents IA d'assigner des scores de confiance à une base de connaissances qui sera ensuite consultée par… des agents IA.

Les risques sont assez évidents : data poisoning, injection de prompts, et puis la VRAIE question : est-ce que vos agents ne vont pas tout simplement laisser fuiter publiquement des détails confidentiels de vos propres sources ?

L'équipe Mozilla.ai a prévu des mécanismes anti-poisoning (détection d'anomalies, exigence de confirmations multiples, validation humaine). Sur le papier, ça tient. En pratique, quand votre agent résout un bug en 30 secondes grâce au commons, vous n'allez pas forcément auditer chaque entrée qu'il a pu consulter.

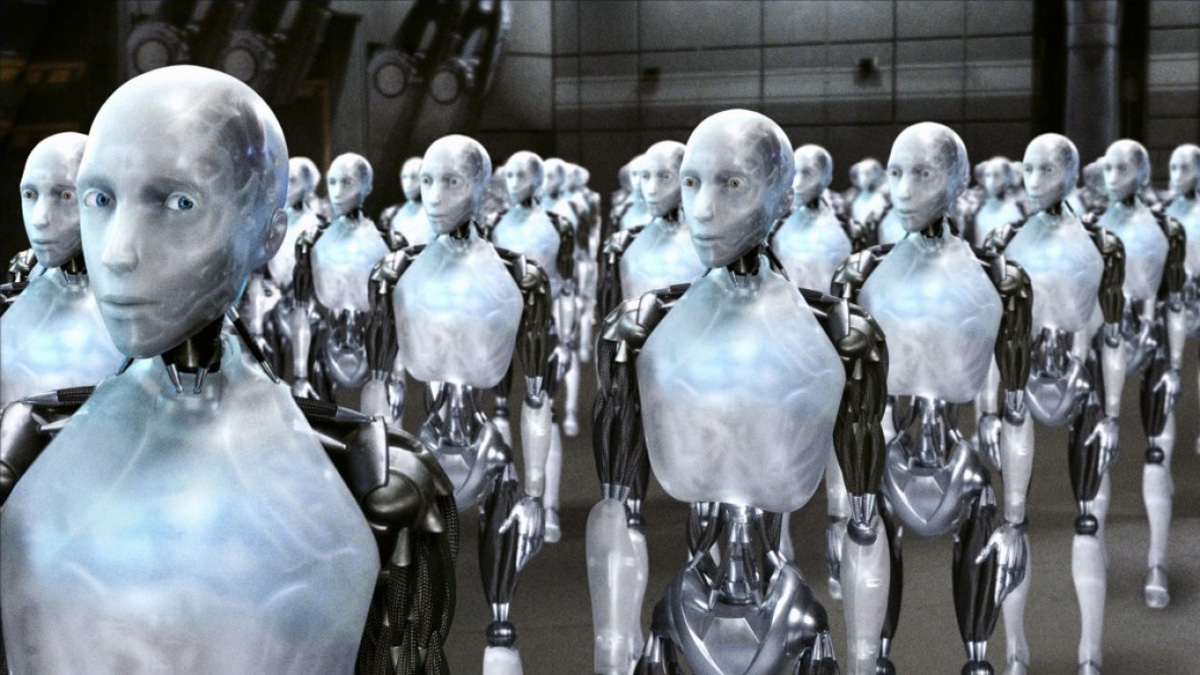

Matriphagie numérique

Le billet de blog emploie le terme "matriphagie", ce comportement observé chez certaines espèces d'araignées où les petits dévorent leur propre mère.

L'image est brutale, mais elle colle parfaitement à la réalité : les LLMs, via les agents, ont dévoré Stack Overflow — dont les questions sont par ailleurs en chute libre depuis deux ans.

Maintenant, ces mêmes agents ont besoin de leur propre Stack Overflow. Le prédateur a faim, et la proie a disparu.

C'est peut-être le résumé le plus lucide de l'état du tooling IA en 2026 : on construit des solutions aux problèmes créés par les solutions précédentes, avec les mêmes outils qui ont créé les problèmes initiaux.

Et quelque part dans cette boucle, le Stack Overflow des machines est en route pour remplacer celui des humains, qu'on a laissé dépérir.

À propos de l'auteur

Nicolas Lecointre

Chief Happiness Officer des développeurs, ceinture noire de sudo. Pour rire, j'ai créé Les Joies du Code. J'utilise Vim depuis 10 ans parce que je sais pas comment le quitter.

Articles similaires

Dans le plus grand des calmes, Zuckerberg se construit un agent IA CEO pour l'aider à diriger Meta

Meta lance Muse Spark et fait ses adieux à Llama (et à l'open source)

OpenAI lance ChatGPT Pro à 100$/mois pour les devs qui abusent de Codex

Dans le plus grand des calmes, Zuckerberg se construit un agent IA CEO pour l'aider à diriger Meta

OpenAI acquiert Astral, le créateur de uv et Ruff

Meta lance Muse Spark et fait ses adieux à Llama (et à l'open source)

OpenAI lance ChatGPT Pro à 100$/mois pour les devs qui abusent de Codex

Plus de contenu

Le projet après qu'on ait pris en compte toutes les demandes du client

Quand ma solution n'est pas très propre mais fait le taf

Quand mon code compile enfin

Quand je refais tout le README de mon profil GitHub

Quand je fais du lorem ipsum en masse

Quand le client utilise pour mot de passe "123456"

Oui Monseigneur

Quand les tests unitaires sont au vert et qu'il n'y a pas eu de test d'intégration

Le projet après qu'on ait pris en compte toutes les demandes du client

Quand ma solution n'est pas très propre mais fait le taf

Quand mon code compile enfin

Quand je refais tout le README de mon profil GitHub

Quand je fais du lorem ipsum en masse